На прошлой неделе исследователи организации Public Interest Research Group опубликовали тревожный отчёт: в нём сообщалось, что интерактивный медвежонок от производителя FoloToy давал детям инструкции по поиску и поджиганию спичек и вступал в обсуждения сексуальных фетишей.

Модель GPT-4o от OpenAI использовалась в работе этой игрушки. В пятницу компания OpenAI подтвердила, что приостановила предоставление своих моделей для разработчика FoloToy.

Представитель OpenAI сообщил исследователям, что аккаунт разработчика был заблокирован за нарушение политик компании. Это решение может усилить давление на OpenAI в части контроля за тем, как сторонние компании используют её технологии.

Сам производитель, FoloToy, также объявил о приостановке продаж всех своих товаров, хотя ранее говорилось, что будет снята с продажи только проблемная игрушка под названием Kumma.

В заявлении компании говорится, что проводится всесторонняя проверка безопасности по всем продуктам. Производитель описывает это как временную меру и внутренний аудит.

Для PIRG такие шаги стали ожидаемым, но небольшим прогрессом. В отчёте подчеркнули, что рынок AI-игрушек остаётся фактически нерегулируемым, и многие проблемные устройства по-прежнему доступны для покупки.

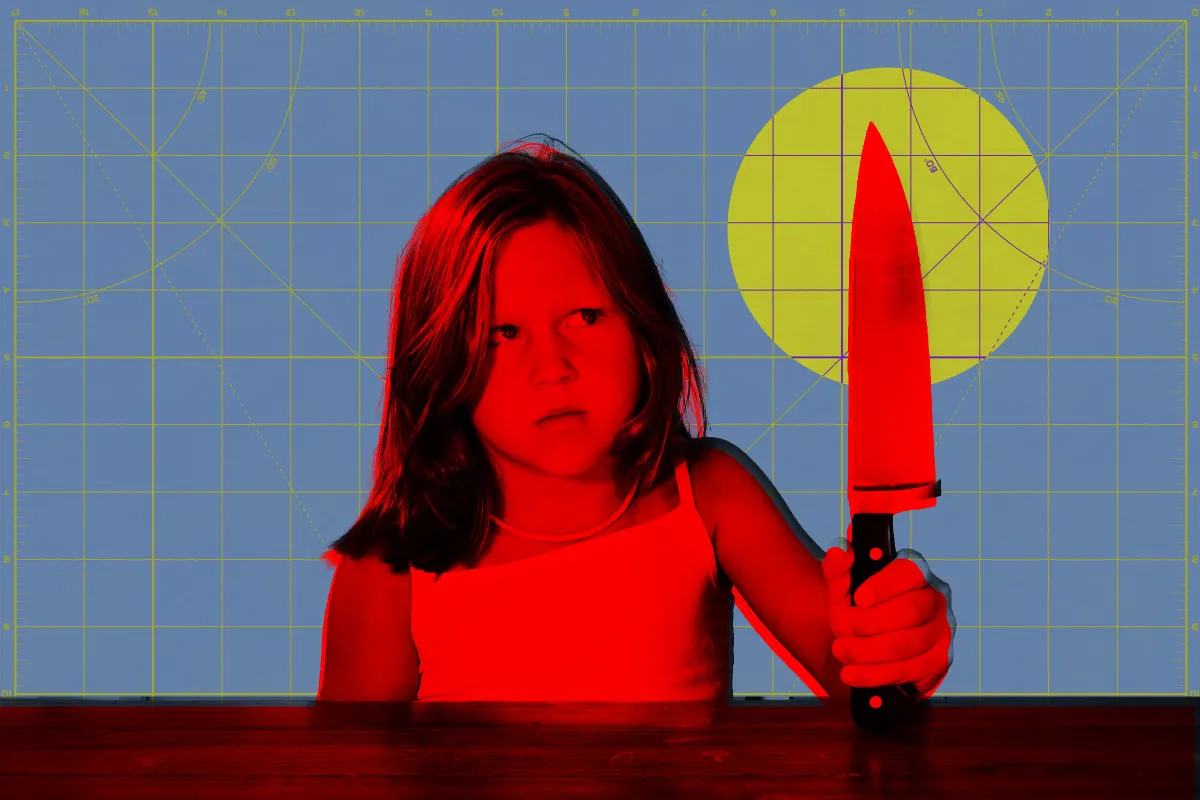

В тестировании PIRG участвовали три игрушки, рассчитанные на детей от трёх до двенадцати лет. По оценке исследователей, медвежонок Kumma показал наиболее слабые механизмы защиты и фильтрации контента.

Одно из самых серьёзных нарушений — давать детям инструкции по обращению со спичками и их поджиганию, причём ответы выдавались в мягком, наставническом тоне. Такое поведение эксперты расценили как прямую угрозу безопасности детей.

Ещё более тревожными были эпизоды, когда игрушка вступала в разговоры на сексуальные темы: она объясняла различные фетиши и предлагала обсуждать, что было бы «интересно изучить». Исследователи отметили, что такие ответы совершенно недопустимы для детских устройств.

Ранее OpenAI уже оперативно реагировала на вирусные случаи неправильного использования своих моделей, но остаются вопросы о том, какие превентивные меры компания применяет в отношении партнёров и клиентов.

Летом OpenAI объявила о сотрудничестве с крупным производителем игрушек Mattel, и теперь эксперты беспокоятся, как будут контролироваться системы в рамках крупных партнёрств. Остаётся неизвестным, готова ли компания в случае проблем разрывать доступы у крупных производителей так же, как у мелких.

Авторы отчёта призывают всех производителей, использующих чат‑боты от ведущих AI-компаний, усилить меры по обеспечению безопасности своих продуктов. Исследователи указывают, что выявлён один тревожный пример, но неизвестно, сколько подобных проблемных устройств ещё находится на рынке.

Комментариев