В эпоху искусственного интеллекта онлайн-знакомства перестали ограничиваться простым свайпом или сообщением. К 2025 году многие привлекательные профили могут оказаться не людьми, а синтетическими образами, созданными с помощью глубокой фальсификации. Мошенники тем временем значительно повысили уровень своих приёмов благодаря генеративным инструментам.

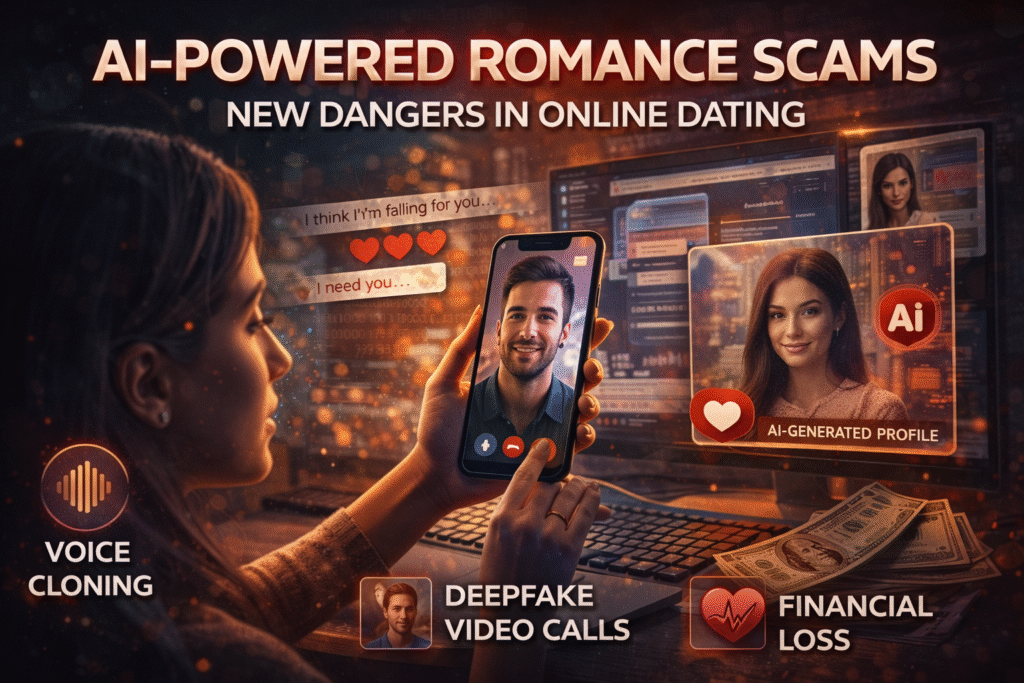

Современные схемы романтического мошенничества включают реалистичные видеозвонки с использованием дипфейков, чат‑боты, подражающие эмоциональной реакции, клонирование голосов и персонализированные истории, рассчитанные на конкретного пользователя. Это делает обман особенно убедительным и труднораспознаваемым.

Пострадавшие бывают не только наивными или технически неосведомлёнными пользователями. Даже люди с высоким уровнем цифровой грамотности всё чаще становятся жертвами, потому что речь идёт не только о внешнем впечатлении — машины моделируют поведение и эмоции, создавая иллюзию реального общения.

Романтические мошенничества существуют с ранних дней интернета, но сейчас качество обмана заметно выросло. Инструменты, ранее применявшиеся в кинопроизводстве или научных исследованиях, стали доступны злоумышленникам и используются для создания правдоподобных вымышленных персон.

Сегодняшние злоумышленники используют искусственный интеллект для генерации фотореалистичных изображений и видео, для симуляции голосовых разговоров через технологии клонирования голоса, для ведения длительных эмоционально насыщенных переписок с помощью мощных языковых моделей и для подстройки поведения под идеал партнёра с учётом данных из социальных сетей.

В Индии наблюдается рост числа случаев мошенничества, подпитываемого ИИ: за период с 2022 по 2024 год число сообщений о романтических афёрах увеличилось примерно на 300 процентов, а оценочные убытки в 2024 году превысили 270 крор рупий. Жертвами становятся преимущественно образованные городские жители в возрасте 25–40 лет; часто мошенники выдают себя за НРИ, врачей, военных или руководителей в технологической сфере.

Психологическое воздействие таких атак нередко сопутствует финансовым потерям: люди сообщают о глубокой эмоциональной травме, общественном стыде и чувстве предательства. Последствия выходят за рамки материального ущерба и затрагивают личную жизнь и доверие.

Ключевые технические приёмы, делающие обман убедительным, включают создание гиперреалистичных видеоматериалов с помощью специализированных платформ, клонирование голоса по коротким аудиозаписям и применение адаптивных чат‑моделей, которые запоминают детали переписки и подстраиваются под эмоциональное состояние собеседника. Некоторые схемы используют параллельные автоматизированные разговоры, что позволяет масштабировать афёру на многих жертв одновременно.

Реальная история иллюстрирует механизм: мужчина познакомился в приложении с человеком, который вёл долгую переписку, присылал фото и звонил, а затем попросил значительную сумму денег под предлогом экстренной ситуации в поездке. После перевода денег собеседник исчез, а экспертиза показала, что фотографии были сгенерированы, а голос — клонирован.

Признаки возможного мошенничества включают слишком быстрое и идеализированное выражение чувств, повторяющийся или механистичный стиль сообщений, настойчивые попытки перевести общение в закрытые мессенджеры и постепенное появление финансовых «неотложных» просьб. Обращайте внимание на попытки избежать видеозвонков с живой проверкой и на несостыковки в рассказах.

Для защиты можно использовать инструменты обратного поиска изображений, которые выявляют совпадения фотографий в сети, а также онлайн‑сервисы для анализа видео на признаки манипуляции и сервисы, позволяющие оценить вероятность машинной генерации текста. Полезна простая видеопроверка в реальном времени с неожиданным действием, которое трудно сымитировать заранее.

Государственные и платформенные меры постепенно развиваются: обсуждаются и внедряются законодательные инициативы, предполагающие уголовную ответственность за использование ИИ для личного мошенничества, требования маркировки сгенерированного контента и интеграция средств обнаружения на сервисах знакомств. Органы правопорядка усиливают оснащение для криминалистического анализа дипфейков и иных следов цифрового обмана.

Можно ли всё ещё доверять цифровым отношениям? Ответ положительный, но с оговорками: реальные связи возможны, однако требуются осторожность и проверка. Не стоит слишком быстро эмоционально привязываться к незнакомцам в сети, проверяйте личность через разные каналы и никогда не отправляйте деньги тем, кого вы не встречали лично.

В заключение, мошенничества с применением ИИ стали серьёзной проблемой, но осведомлённость, базовые навыки цифровой гигиены и поддержка сообщества остаются надёжной защитой. Технологии сами по себе не преступны, но ответственность за безопасность лежит на пользователях, платформах и регуляторах.

Комментариев