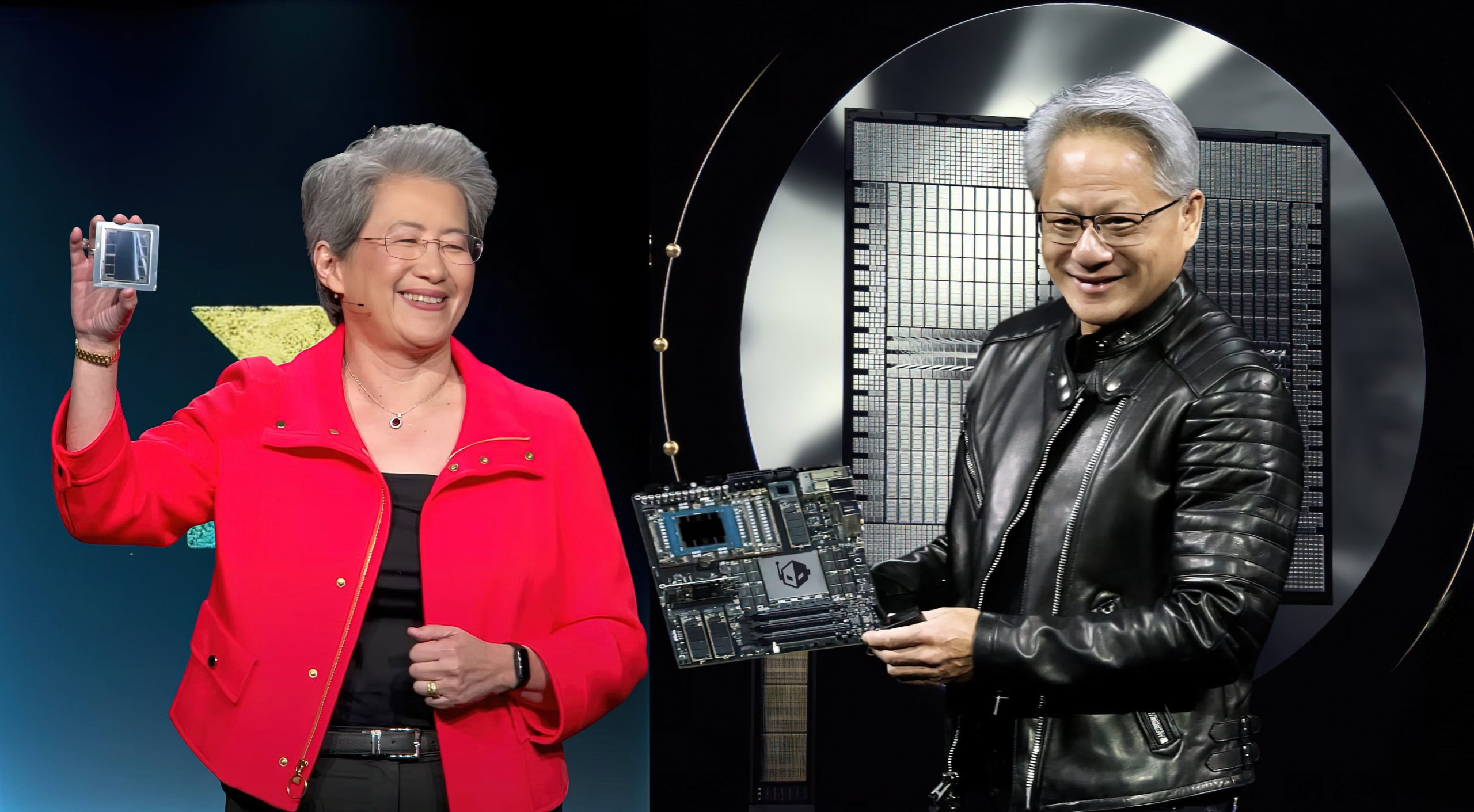

Испытания показали, что серверные стойки NVL72 на базе графических процессоров Blackwell GB200 заметно опережают решения на AMD Instinct MI355X в среде Mixture of Experts (MoE). Разрыв по производительности в отчётах оценивается как крайне значительный.

Многие современные модели ИИ смещаются в сторону архитектур MoE, поскольку они позволяют эффективнее использовать вычислительные ресурсы за счёт выделения отдельных подсетей — «экспертов». При этом масштабирование MoE создаёт серьёзные узкие места из‑за интенсивной all‑to‑all коммуникации между узлами, что увеличивает задержки и нагрузку на пропускную способность сети.

В независимых бенчмарках отмечается, что пропускная способность на один GPU при 75 токенах в секунду у GB200 превосходит показатели MI355X примерно в 28 раз в сопоставимых конфигурациях. Также в отчётах приводятся соотношения эффективности по затратам — около 3,1× при 25 токенах в секунду и примерно 15× при 75 токенах в секунду.

Для снижения проблем масштабирования в MoE применяется подход «совместного проектирования» (co‑design): конфигурация стойки с 72 чипами GB200 и общей быстрой памятью объёмом около 30 ТБ. Такая архитектура позволяет более эффективно распараллеливать работу «экспертов» и уменьшать накладные расходы на передачу данных.

Анализ цен в облачных прайсах показывает, что стойки GB200 NVL72 обеспечивают существенно более низкую стоимость на токен — примерно в одну пятнадцатую по сравнению с альтернативами при более высокой интерактивности. В совокупности это даёт заметное преимущество по показателю «производительность на доллар» и объясняет широкое распространение этой платформы у крупных облачных провайдеров.

Решения на базе MI355X сохраняют конкурентные преимущества в высокоплотных конфигурациях благодаря большой ёмкости HBM3e. Тем не менее в задачах, ориентированных именно на MoE, текущая лидирующая позиция за платформой GB200, и конкуренция, вероятно, усилится с появлением новых стоечных решений, таких как Helios и Vera Rubin.

Комментариев